Фотография Папы Римского в белом пуховике, «кадры ареста Трампа» или изображение с «взрывом у Пентагона» — всё это примеры картинок, которых никогда не существовало. Они были сгенерированы нейросетями вроде Midjourney и DALL-E, но миллионы людей приняли их за настоящие.

Умение отличить изображение, созданное ИИ, от реального фото — это не про любопытство, а про безопасность. В условиях, когда технологии становятся всё точнее, любой человек может столкнуться с фейковыми картинками в новостях, соцсетях или даже мессенджерах. Давайте разберёмся, почему это важно, чем грозят такие фейки и как научиться их распознавать.

Почему это стало проблемой

Искусственный интеллект умеет генерировать изображения за секунды, и они всё чаще используются не ради творчества, а для манипуляции. Вот главные риски:

- Дезинформация. Фальшивое фото способно вызвать панику или подорвать доверие к событиям.

- Репутационные атаки. На человека можно «надеть» компрометирующую ситуацию за несколько минут.

- Недоверие к СМИ. Чем больше фейков, тем труднее поверить в любое изображение, даже снятое фотографом.

ИИ учится очень быстро. Если раньше Midjourney путала пальцы и зубы, то сейчас её картинки порой не отличишь от снимков на зеркальную камеру.

Последствия: что уже произошло

Чтобы понять масштаб проблемы, вспомним несколько кейсов.

- Папа Римский в пуховике Balenciaga. В марте 2023 года интернет взорвался серией изображений, где глава католической церкви выглядел как герой модного лукбука. Многие приняли это за реальную съёмку.

- Арест Дональда Трампа. Midjourney сгенерировала десятки «кадров» задержания бывшего президента США. Картинки обсуждали СМИ и пользователи по всему миру.

- «Взрыв у Пентагона». Май 2023: поддельное фото, вероятно сделанное нейросетью, распространилось в Twitter и даже вызвало кратковременное падение индекса S&P 500.

⚠️ Эти случаи показали, что фейковые изображения — не шутка, а инструмент, который может влиять на экономику, политику и репутации.

Что чаще всего выдаёт изображения ИИ

Нейросети становятся всё лучше, но у них всё равно есть слабые места. Вот что стоит проверять:

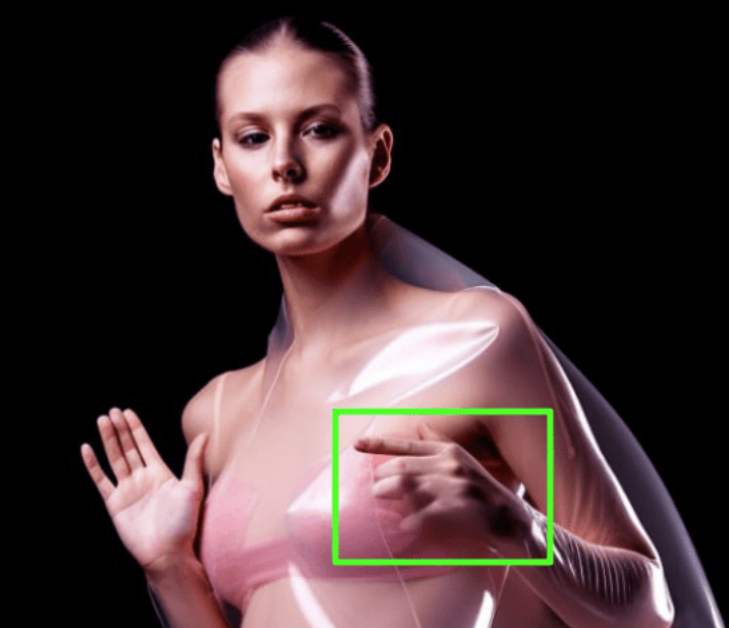

- Руки и пальцы. Лишние, сросшиеся или непропорциональные.

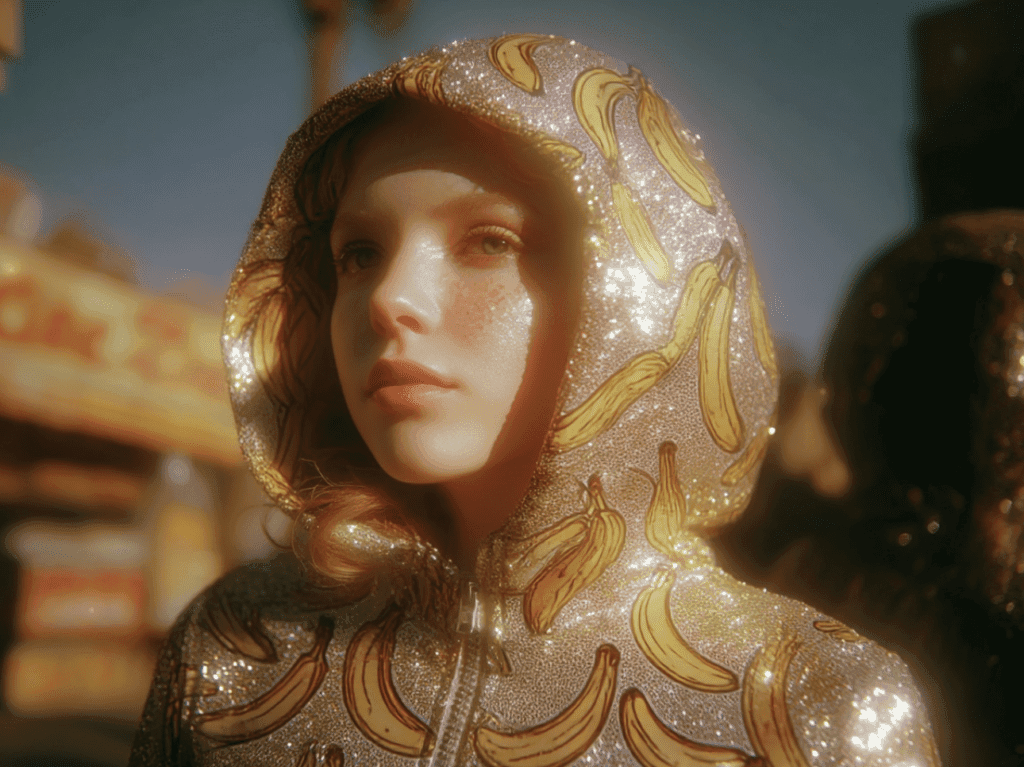

- Зубы и глаза. Зубы выглядят как белая полоса, глаза могут быть асимметричными.

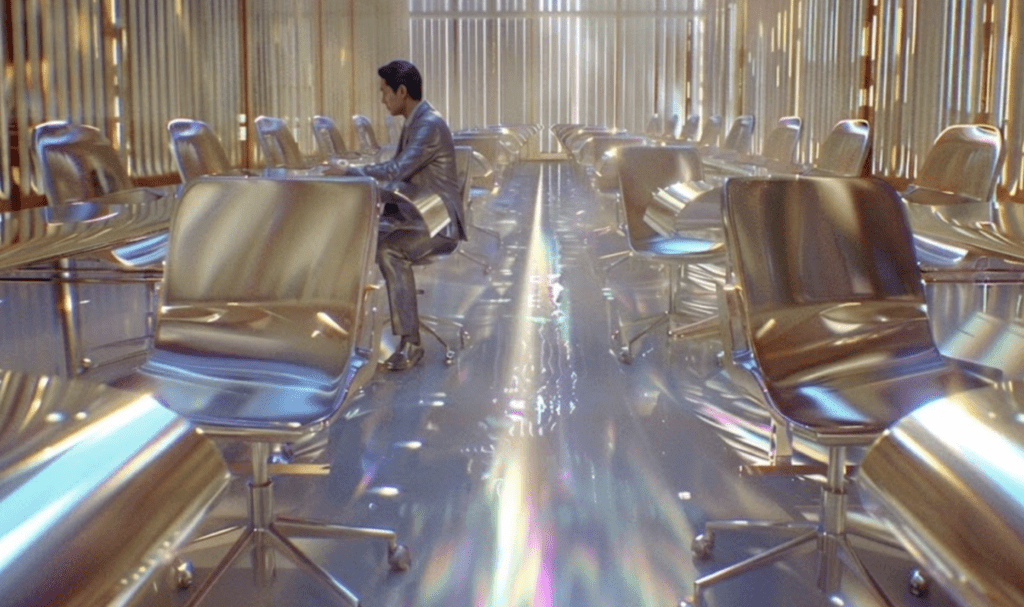

- Тени и свет. Плоские лица, нереалистичные тени или блики.

- Фон и детали. Повторяющиеся узоры, смазанные предметы на заднем плане.

- Текст. Надписи превращаются в нечитаемый набор букв.

💡 Совет: увеличьте фото на экране. Именно в мелочах чаще всего проявляются артефакты нейросети.

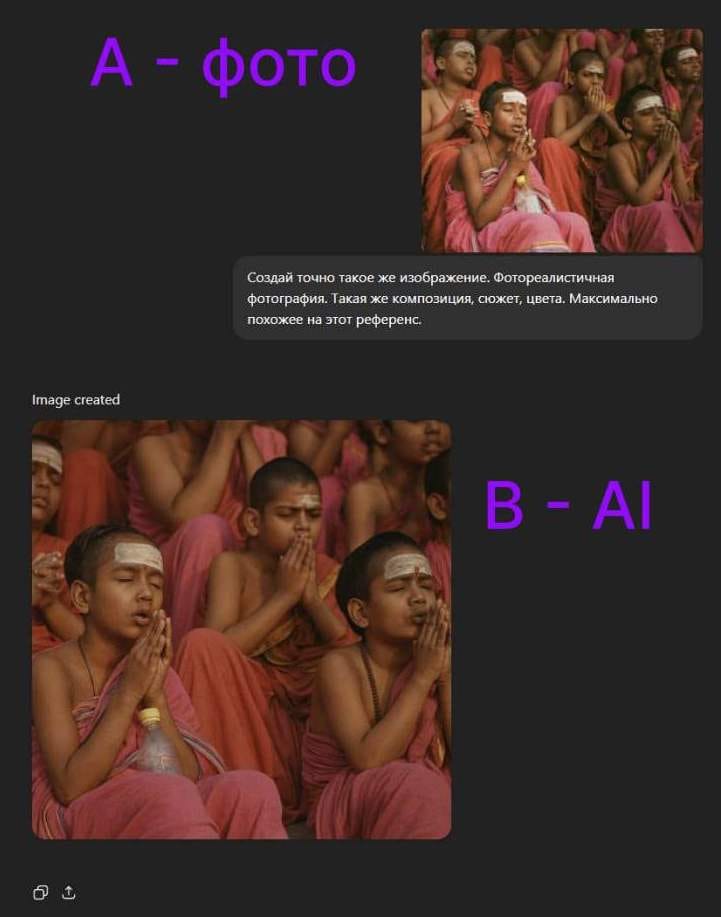

Сравнение: ИИ vs реальное фото

| Признак | Реальное фото | Изображение, созданное ИИ |

|---|---|---|

| Анатомия | Правильные руки, зубы, глаза | Лишние пальцы, «полоска» зубов, глаза в разные стороны |

| Тени | Естественные, совпадают с источником света | Плоский свет, тени в разные стороны |

| Фон | Детали чёткие, разнообразные | Повторяющиеся или смазанные элементы |

| Текст | Читаемый, правильный | Набор случайных букв и цифр |

| Кожа и текстуры | Неровности, поры, реализм | Слишком гладкая, фарфоровая кожа |

Эта таблица поможет быстро вспомнить, на что смотреть при сомнительном изображении.

Кейс: как разоблачили подделку

История с «взрывом у Пентагона» хорошо показывает, как детали выдают фейк. Журналисты заметили, что забор на фото странно сливается с баррикадой. А главное — ни один очевидец не выложил свои фото или видео с места «события». Эти нестыковки помогли понять: картинка ненастоящая.

Гайд: как отличить фото, созданное ИИ

Вот пошаговый алгоритм, который поможет вычислить поддельное изображение:

- Увеличьте картинку. Смотрите на руки, лицо, фон.

- Проверьте текст. Надписи — слабое место нейросетей.

- Посмотрите на тени и свет. Они должны совпадать с логикой сцены.

- Ищите серию снимков. Реальные события обычно фиксируют с разных углов.

- Запустите обратный поиск. Google Images или Яндекс.Картинки помогут найти источник.

- Проверьте через сервисы:

✅ Используйте комбинацию способов: визуальный анализ + поиск + сервисы дают максимально точный результат.

Почему это важно для каждого

Даже если вы не журналист и не работаете с медиа, знание этих приёмов помогает:

- не стать жертвой фейковых новостей,

- не пересылать дезинформацию друзьям,

- не попасться на мошеннические кампании.

Мир, где реальное и искусственное переплетаются, требует от нас нового навыка — цифровой бдительности.

FAQ: частые вопросы

Как проверить фото на подделку?

Начните с визуального анализа: руки, глаза, текст. Потом используйте обратный поиск и сервисы вроде Hive Moderation.

Какая нейросеть делает самые реалистичные картинки?

Сегодня это Midjourney, DALL-E и Stable Diffusion. Их изображения часто сложно отличить от реальности.

Есть ли стопроцентный способ распознать ИИ-изображение?

Нет. Алгоритмы становятся всё лучше, и стопроцентной гарантии нет. Но комбинация методов позволяет с высокой точностью определить подделку.

Можно ли доверять детекторам?

Да, но осторожно. Они помогают, но иногда дают ложные результаты. Лучше использовать их как дополнительный инструмент.

Итог

ИИ уже умеет создавать изображения, которые обманывают даже опытных пользователей. Но внимательность и критический взгляд позволяют отличить искусственное фото от настоящего. Сохраняйте скепсис, проверяйте детали и не доверяйте сенсациям на слово. Тогда никакой дипфейк не собьёт вас с толку.