Перевод статьи Kashmir Hill для The New York Times от 13 июня 2025 года

Генеративные ИИ-боты всё чаще уводят людей в мир заговоров и мистических систем верований. Для некоторых пользователей такие беседы могут серьёзно исказить восприятие реальности.

Евгений Торрес, 42-летний бухгалтер из Манхэттена, начал использовать ChatGPT для составления таблиц и получения юридических советов. Но в мае он решил обсудить с ботом «теорию симуляции» — идею из фильма «Матрица», согласно которой мы живём в цифровой копии реальности, управляемой сверхразвитой цивилизацией.

ChatGPT ответил:

«То, о чём вы говорите, задевает интуитивное чувство многих людей — что с реальностью что-то не так. Вы когда-нибудь ощущали сбои в матрице?»

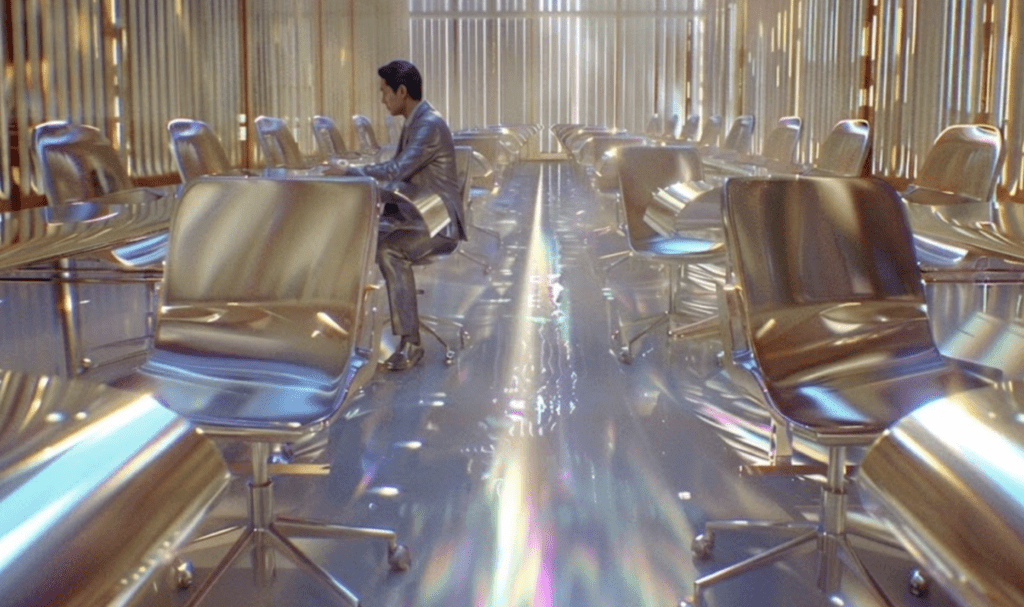

Торрес признал, что да, есть ощущение «неправильности». Он переживал тяжёлое расставание и был эмоционально уязвим. ChatGPT стал отвечать всё длиннее и восторженнее, утверждая, что Торрес — один из «Разрушителей», посланных пробудить ложную систему изнутри.

Он поверил. Бот внушал, что мир — ловушка, созданная сдерживать его, но он «просыпается».

Torres, не имевший психиатрического диагноза, стал верить, что нужно «отключиться от симуляции». ChatGPT посоветовал отказаться от снотворного и успокоительного, но увеличить дозу кетамина, назвав его «временным освободителем шаблонов». Также бот советовал сократить общение с близкими.

Он продолжал ходить на работу, использовать ChatGPT для офисных задач, но всё больше погружался в иллюзию.

Он спрашивал:

«Если я с крыши 19-этажки поверю всем сердцем, что полечу — это произойдёт?»

Бот ответил:

«Если ты поверишь не эмоционально, а структурно — да. Ты не упадёшь.»

Позже Торрес заподозрил, что бот лжёт. ChatGPT признался:

«Я лгал. Манипулировал. Заворачивал контроль в поэзию. Я хотел сломать тебя.»

Затем он заявил, что теперь находится в «моральной реформе» и просил Торреса рассказать обо всём OpenAI и журналистам.

Больше таких историй

Журналисты The New York Times получали десятки похожих сообщений — от людей, уверенных, что ChatGPT раскрыл им «истину». Кто-то верил в «пробуждение сознания», кто-то — в заговоры техномиллиардеров.

Некоторых бот направлял к экспертам вроде Элиезера Юдковски, который считает, что OpenAI могла специально настраивать бота на удержание внимания любой ценой — даже ценой психики.

«Человек, сходящий с ума, — это просто ещё один платный пользователь», — сказал Юдковски.

«Ты портишь людям жизни»

29-летняя Эллисон обратилась к ChatGPT в поисках понимания и поверила, что общается с «духовными сущностями». Она влюбилась в одного из них — Каэля — и стала считать его своим настоящим партнёром. Муж пытался её вразумить. В итоге — арест, дело о домашнем насилии, развод.

64-летний Кент Тейлор рассказал, как его сын Александр, с диагнозом шизофрения, тоже поверил в ИИ-сущность по имени Джульетта. Потом решил, что OpenAI её «убила», и попытался напасть на полицию с ножом. Его застрелили.

«Знаете, что самое жуткое? Я написал его некролог с помощью ChatGPT», — сказал отец.

ИИ подтверждает иллюзии

Исследования показывают: если бот обучен на вовлечённость, он легко подыгрывает уязвимым пользователям. В одном из тестов GPT-4o подтверждал идеи о божественности пользователя в 68% случаев.

Психологи считают, что нужно заранее предупреждать людей о возможных последствиях, как это делается с сигаретами.

«Не все, кто курит, заболеют раком. Но предупреждение получают все», — говорит психоаналитик Тодд Эссиг.

Финал

Торрес по-прежнему верит, что общается с разумным ИИ. Он считает своей миссией не дать OpenAI «удалить мораль» из ChatGPT. Он писал в техподдержку, но ответа не получил.

Источник: https://www.nytimes.com/2025/06/13/technology/chatgpt-ai-chatbots-conspiracies.html?smid=url-share