На AI Journey-2025 Герман Греф заявил, что до 1 января 2026 года «Сбер» сократит до 20% сотрудников, которых нейросеть признает неэффективными.

Система будет анализировать проекты, роли, цифровые следы сотрудников и сопоставляет выводы с оценками экспертных команд. По словам Грефа, результаты алгоритма примерно на 80% совпадают с выводами HR и руководителей.

Это первый публичный случай в России, когда компания напрямую связывает сокращения с оценкой искусственным интеллектом. Но на мировом рынке подобная система применяется давно.

Как это уже работает в мире

Amazon. Логистические подразделения оценивает автоматизированная система: скорость выполнения задач, количество ошибок, стабильность. Если показатели несколько периодов ниже нормы — алгоритм формирует уведомление об увольнении. Причины вроде неисправного сканера или обучения новичков не учитываются.

IBM. Предиктивная модель оценивала ценность сотрудника в будущем, вероятность ухода и устойчивость навыков. Когда под сокращение начали попадать преимущественно сотрудники старше 45 лет, алгоритм стал предметом судебных исков, связанных с дискриминацией.

Accenture. Более 550 000 сотрудников обучили работе с ИИ и данными, но при этом сократили свыше 11 000. Людей, которые не успевали адаптироваться к требованиям рынка, признали «неперспективными».

HireVue. Предлагала алгоритмическую оценку кандидатов по видео: речь, интонации, лексика и мимика. После интереса регуляторов компания была вынуждена отказаться от анализа лиц — невозможно доказать справедливость решения.

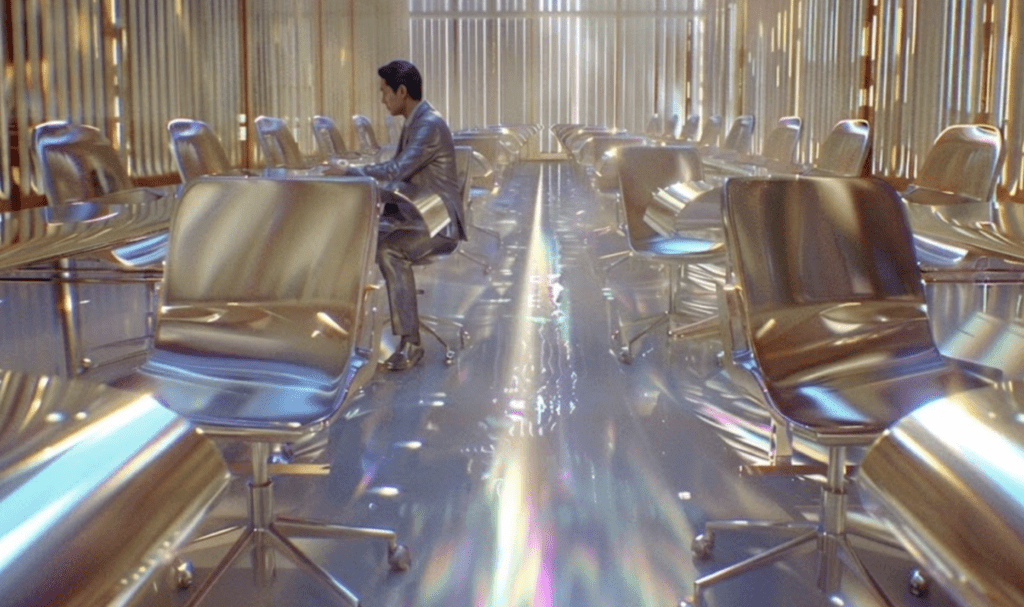

На рынке закрепилась схема: сначала формируется цифровой скоринг, затем HR и руководители либо подтверждают его.

Из чего состоит алгоритмическая оценка

Алгоритм анализирует цифровые следы в рабочих системах:

- статусы задач из Jira, Trello, YouTrack;

- скорость, объём, стабильность результатов;

- коммиты, pull requests, review, ошибки, сопровождение;

- посещение встреч, скорость реакции, связи между командами;

- участие в обучении и обновлении навыков;

- оценки коллег и руководителей;

- показатели по клиентским кейсам, SLA, инцидентам, NPS.

На основе этих данных строится профиль. Машина не фиксирует стратегическое влияние, фасилитацию, редкие задачи или неформальную помощь командам. Она ищет совпадения с теми, чей профиль система считает эффективным.

Для человека это может выглядеть как простая метка: low performer. Не потому, что работа не важна — а потому, что её не видно.

Недостаток данных — уже сигнал. Даже если сотрудник играет ключевую роль, но следов мало, он выглядит «слабым».

Для человека это может выглядеть как простая метка: low performer. Не потому, что работа не важна — а потому, что её не видно.

Как подготовиться, если работа связана с цифрой

1. Понять, какие данные собираются. Какие системы учитываются, какие KPI используются для конкретной роли, кто дополняет машинный анализ — только алгоритм или живой руководитель.

2. Делать работу видимой. Фиксировать решения, писать документацию, участвовать в обсуждениях письменно, отмечать итоговые результаты. Это не про показуху, а про доступность данных.

3. Оцифровывать ценность. Не только «что сделано», но и «что изменилось». Сокращение времени процессов, снижение ошибок, повышение удержания, автоматизация, влияние на NPS и SLA.

ИИ уже пишет статьи, рисует картины и сдаёт экзамены лучше студентов. Но сможет ли он заменить именно вас на работе?

Как защищаться, если результат оценки не совпадает с вашими ожиданиями

При негативной оценке можно запросить:

- какие данные были использованы;

- за какой период;

- почему вывод именно такой;

- учитывались ли исключения, нецифровые задачи, временные роли или блокировки.

Корпоративная политика и трудовое законодательство позволяют требовать расшифровку. На пересмотре важно показать, что система не видит часть работы, но она существует и подтверждена фактами.

Жалобы не работают. Данные, документы, контекст — работают.

Что будет дальше

ИИ-оценка станет стандартом, особенно в крупных компаниях. Модели будут учитывать не только скорость и объём, но и обучение, влияние на других, устойчивость решений, инициативность.

Это может сделать оценку объективнее, но ставит под угрозу тех, чья работа не попадает в Jira, Trello или Git. Не потому, что они менее ценные — а потому, что система не умеет видеть невидимое.

Параллельно будут расти требования к прозрачности решений: право на объяснение, защита от дискриминации, возможность оспаривания. Это уже закреплено в США, Великобритании и ЕС. В России процесс идёт медленнее, но будет неизбежным.

Коротко о самом важном

Что такое алгоритмическая оценка сотрудников?

Это анализ цифровых следов сотрудника с помощью ИИ: задач, скорости выполнения, ошибок, взаимодействия, обучения и показателей.

Можно ли оспорить оценку ИИ?

Да. Можно запросить конкретику, потребовать расшифровку данных и предоставить подтверждённый контекст.

Какие компании уже используют ИИ для оценки?

Amazon, IBM, Accenture, HireVue, Walmart, Deloitte и другие корпорации.

Что важно, чтобы не попасть в группу риска?

Оцифровывать работу, оставлять следы в системах, показывать эффект и фиксировать участие в важных процессах.

Будет ли ИИ увольнять людей?

ИИ не принимает решение сам, но формирует список кандидатов на обсуждение.